很多人做SEO做了半年,文章发了几十篇,谷歌一个排名都没给。问题出在哪?说白了,就是不懂搜索引擎到底怎么工作的,闷着头瞎写。

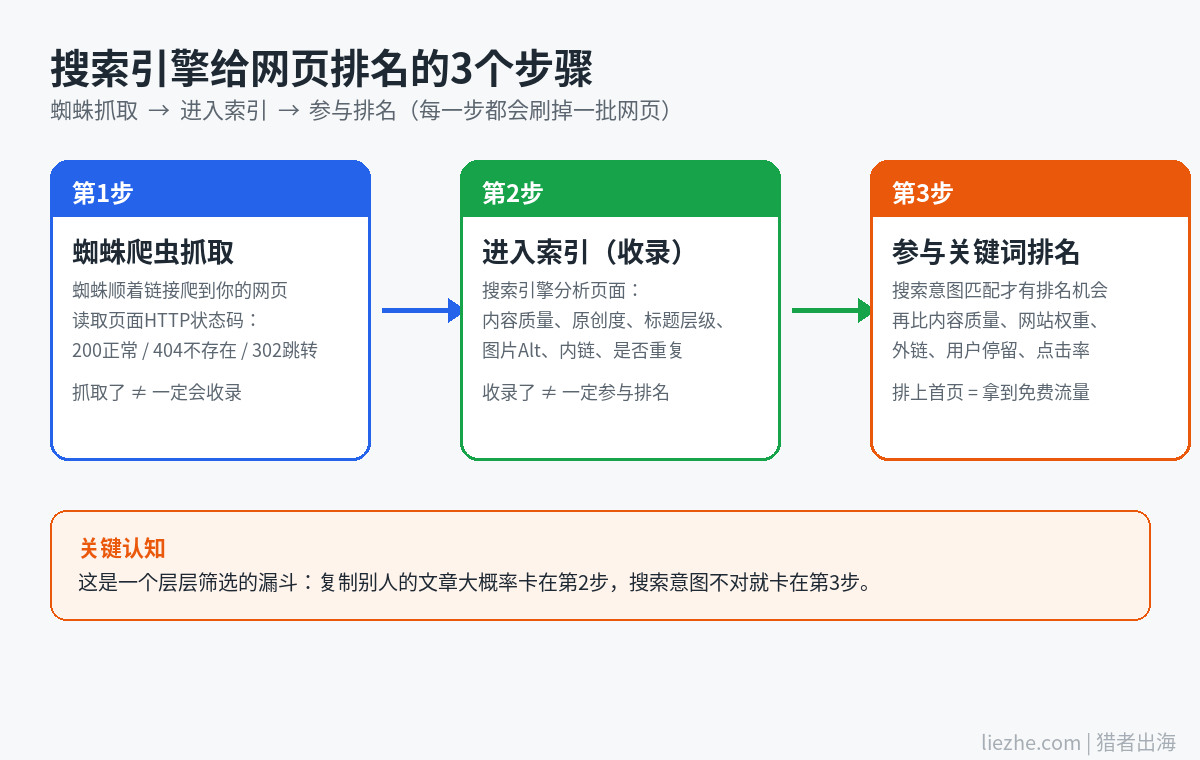

搜索引擎给网页排名,本质上就三步:蜘蛛爬虫抓取你的网页,把网页放进索引库(也就是收录),然后在用户搜索的时候参与关键词排名。

这三步是一个层层筛选的漏斗,抓取了不一定收录,收录了不一定参与排名。猎者出海做了十几年SEO,今天就把谷歌对网页排名的这套底层逻辑,用大白话从头到尾讲清楚,看完你就知道自己的文章卡在了哪一步。

本文目录

蜘蛛爬虫抓取:搜索引擎是怎么发现你网页的

第一步,蜘蛛爬虫抓取。

你可以把搜索引擎的蜘蛛想象成一个不知疲倦的快递员,它顺着一条条链接,从一个网页爬到另一个网页,把看到的内容都搬回去。

蜘蛛抓取你的页面时,第一件事是看HTTP状态码。200代表页面正常,404代表页面不存在,302代表这个地址有跳转。这个状态码就像门牌号,状态码不对,蜘蛛连门都进不去。

这里有个很多新手忽略的点:蜘蛛要能爬到你的页面,前提是有路可走。如果你的网站结构很深,内容页埋在三四层目录下面,或者页面之间没有链接互相连接,蜘蛛就可能根本爬不到。所以网站结构一定要扁平,最好用户从首页点1到2次就能到达任何一个内容页。

还有一种情况是2026年越来越常见的坑:用React、Vue这类前端框架建的站,内容完全靠浏览器执行JavaScript才能渲染出来。谷歌的蜘蛛看到的可能是一个空白页,自然就抓不到内容。这也是为什么猎者出海一直建议新手用WordPress,传统主题是服务端渲染,蜘蛛打开就能看到完整内容,不折腾。

很多人这个时候会问:那能不能用蜘蛛池这种东西人为吸引蜘蛛来抓取?

我可以明确告诉你,谷歌、Bing、百度都能识别蜘蛛池行为,会判定为黑帽SEO操作,基本结果就是降权。猎者出海亲测下来,正常发文章的话,Bing大概1到2分钟就能收录内容页,谷歌也就一天之内的事,根本用不着这种灰色手段。

那怎么主动告诉搜索引擎"我这有新文章"?最干净的办法是装个sitemap插件,提交到谷歌站长工具。

下图是猎者出海在GSC后台提交sitemap的样子,状态成功之后蜘蛛就会按照这张地图来抓取:

记住一句话:抓取了,不等于会收录。蜘蛛把你的页面搬回去了,只是拿到了入场券,能不能进下一轮,还得看第二步。

进入索引(收录):为什么抓取了却没被收录

第二步,进入索引,平时大家叫它收录。

蜘蛛把页面搬回去之后,搜索引擎会对这个页面做一次体检:内容质量怎么样、是不是原创、标题层级清不清楚、图片有没有写Alt标签、内链指向合不合理、跟网站里其他页面是不是重复了。

体检合格的,才会被放进索引库,等着参与排名。体检不合格的,直接刷掉。

最典型的卡在这一步的,就是复制别人的文章。你把同行的文章原封不动搬过来,或者用AI傻瓜式改写一下,搜索引擎一比对,发现互联网上早就有一模一样的内容了,大概率就不收录。即使勉强收录了,也不会给你排名。

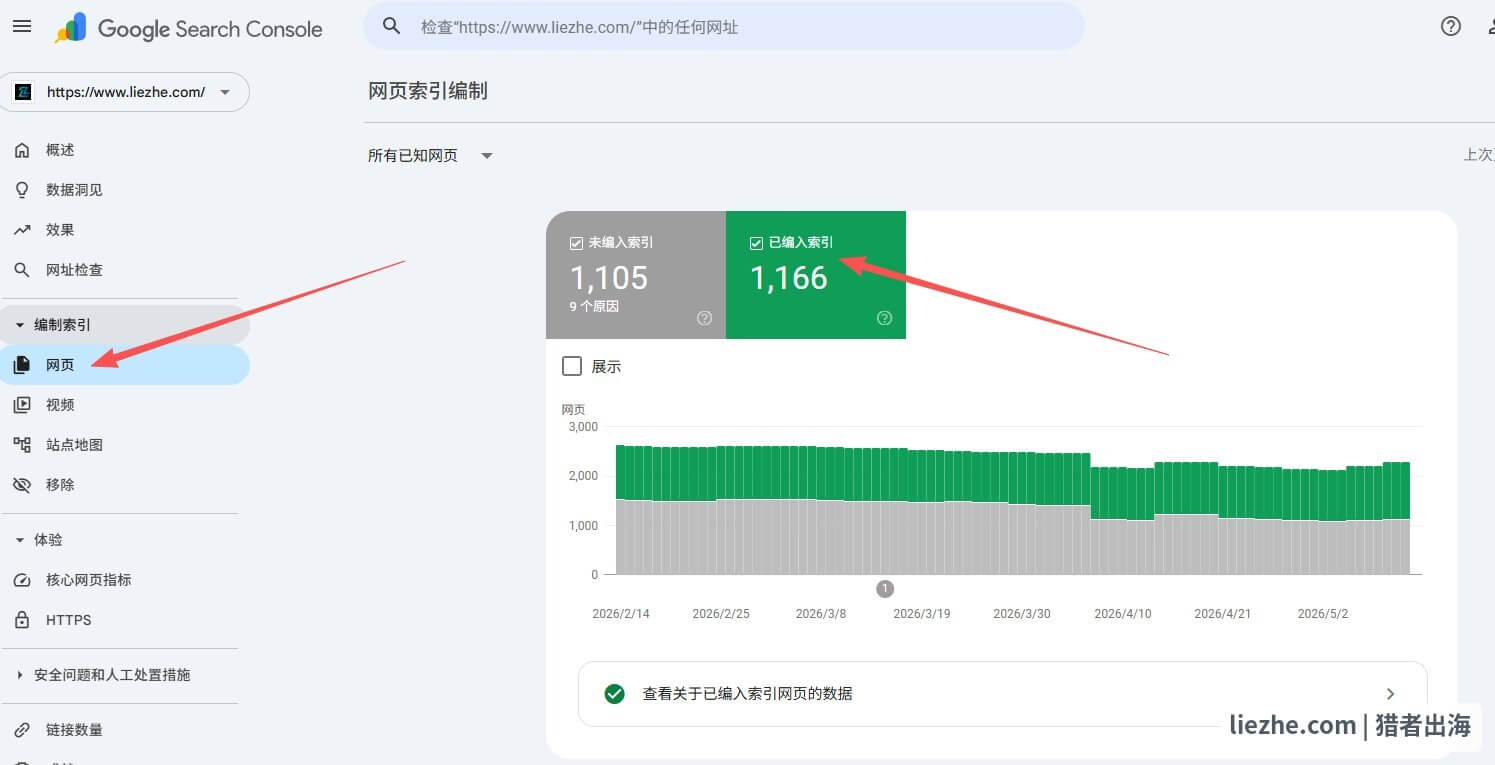

怎么检查自己的页面有没有被收录?最简单的办法是去GSC后台的"网页索引编制"看,已编入索引和未编入索引的数字一目了然。下图是猎者出海这个网站的收录数据:

截至这周,猎者出海一共有1166个页面已编入索引,1105个未编入索引。点击未编入索引那个数字,能看到具体卡在了哪个原因:

这张图特别有参考价值,你看猎者出海未收录的1105个页面里:461个是被robots.txt主动屏蔽的(这是我们故意的,屏蔽掉主题生成的垃圾页面),313个是5xx服务器错误,43个被noindex标记排除,43个是重复网页,21个自动重定向,4个404,1个403,还有200个"已抓取-尚未编入索引",19个"已发现-尚未编入索引"。

"已抓取-尚未编入索引"这个最值得关注,意思是蜘蛛已经来抓过了,但谷歌觉得"暂时还不值得收录"。

背后基本就是内容质量问题。所以你的网站收录率很差,内容质量没问题的话,谷歌和Bing的收录率能到99%甚至100%,收录率低,那一定是内容质量出了问题。

如果只想检查单独某一个页面有没有被收录,直接用GSC顶部的"网址检查工具"丢URL进去就行:

这里要展开讲一下"信息增益"这个概念,这是谷歌2026年3月核心更新重点加权的一个排名信号。

信息增益衡量的是:你的内容相比已经排在前面的那些内容,到底多给了用户多少真正有用的新东西。

检验标准就一句话:如果你这篇文章从互联网上消失了,用户会不会因此失去在别处找不到的信息?

如果答案是"不会",说明你的信息增益基本为零。第一手数据、自己的测试结果、真实的客户案例、独特的分析角度,这些才有信息增益;用AI拼凑改写的、东抄一段西抄一段的综合文章,信息增益为零。

这跟猎者出海一直强调的"不能用傻瓜式指令让AI写内容"是一回事,只不过现在谷歌把它量化成了明确的排名信号。如果你想系统学一遍内容怎么写才能被收录,可以看猎者出海的谷歌SEO教程,里面有完整的内容创作标准。

参与关键词排名:谷歌凭什么把你排到第几位

第三步,参与关键词排名。

页面进了索引库,终于有资格参加排名了,但能排到第几位,是另一场更残酷的竞争。

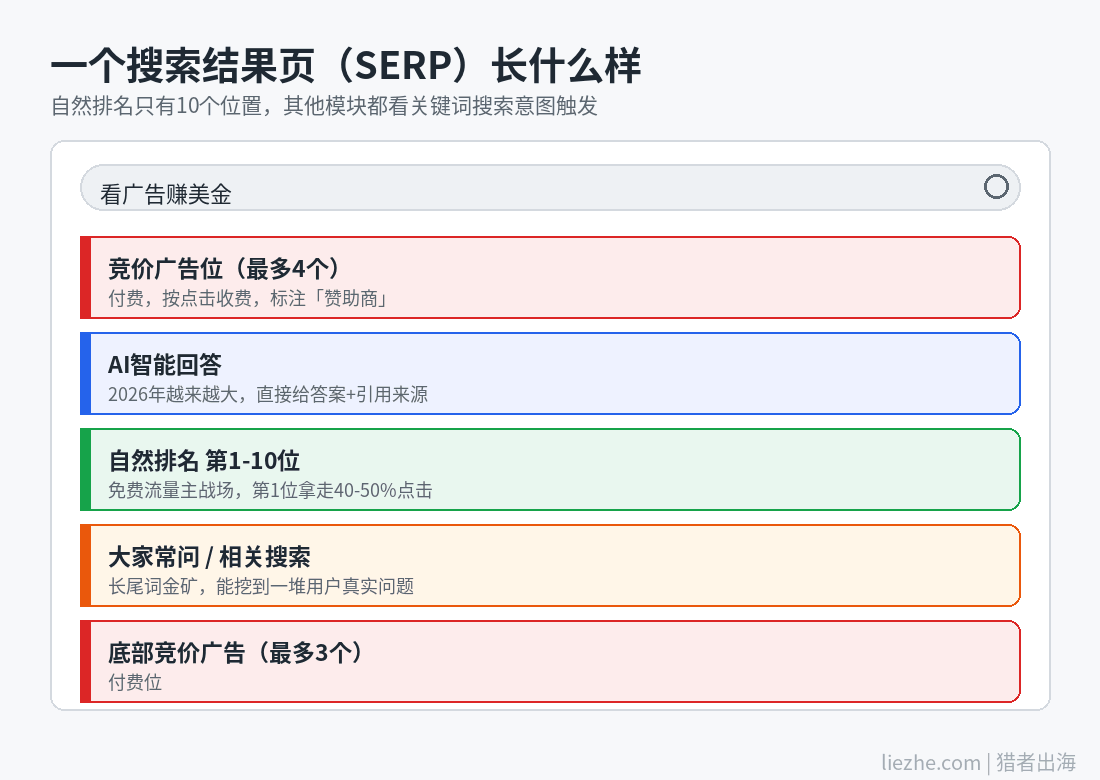

排名的第一道门槛是用户搜索意图。

谷歌特别看重关键词的搜索意图,搜索意图直接决定了搜索结果页会展示什么类型的页面。

举个例子,你搜"耐克运动鞋",出来的全是电商产品页,你写一篇经验文章再好也拿不到排名;你搜"WordPress建站教程",出来的全是教程文章,那你写教程就有机会。搜索意图不匹配,你的页面再优质也是白搭,连参赛资格都没有。

判断搜索意图最简单的办法,就是把你想做的关键词放到谷歌或Bing里搜一下,看前三页展示的是什么类型的页面。如果跟你能写的内容类型对得上,这个词就能做;对不上,直接换词,别浪费时间。

过了搜索意图这一关,接下来就是比硬实力了。

影响排名的因素很多:内容质量、网站权重、外链数量、用户停留时间、点击率、页面加载速度、内容新鲜度等等。

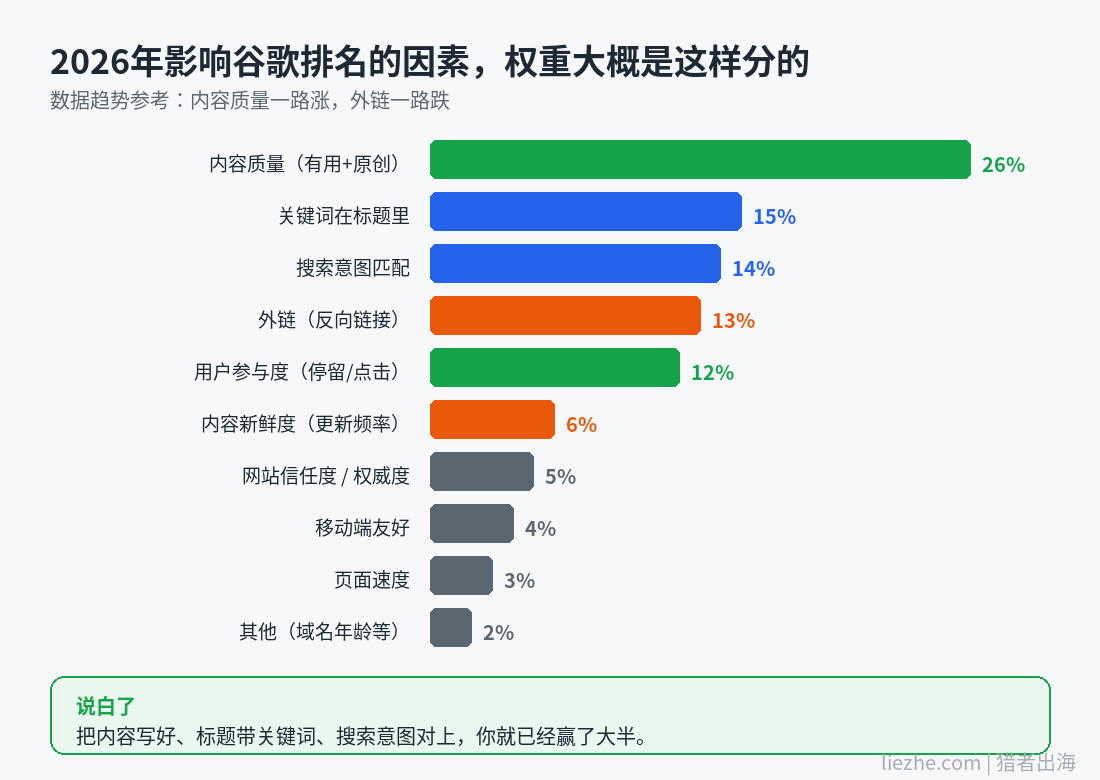

这些因素的权重不是平均的,2026年的大概分布是这样的——内容质量占了大头,将近26%;关键词在标题里占15%;搜索意图匹配占14%;外链占13%,注意外链的权重这几年一路在跌,曾经占到50%以上,现在稳定在13%左右。

这个权重分布告诉我们一个很关键的事:

谷歌的AI已经足够聪明,能直接评估你内容的质量和可信度,不再像以前那样高度依赖别的网站给你投票(外链)。说白了,把内容写好、标题带上核心关键词、搜索意图对上,你就已经赢了大半。

还有一个2026年权重暴涨的因素是内容新鲜度,从以前不到1%涨到了现在的6%左右。

每年至少更新一次的页面,平均能提升4.6个排名位置。

而且谷歌的AI回答模块通常优先引用6个月内更新过的内容。所以文章发出去不是终点,定期更新数据和截图,是排名能持续往上走的关键。

想偷懒只改发布日期不改内容?谷歌能识别这种假装更新的行为,反而会被惩罚。

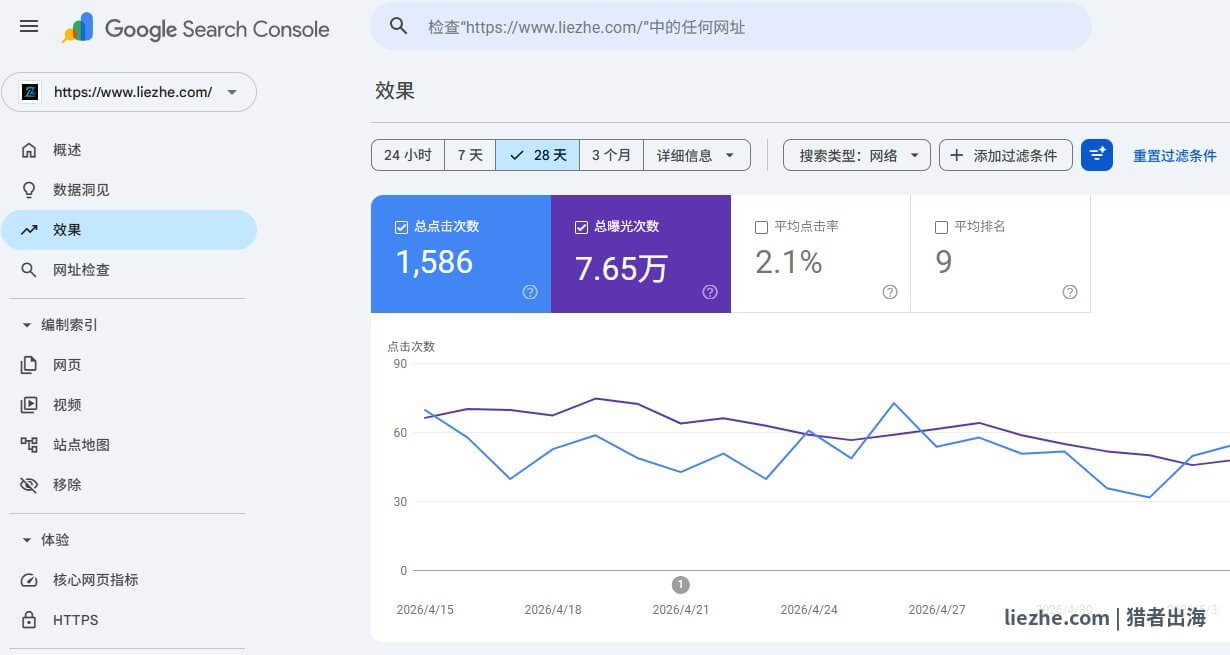

那这套排名逻辑实际跑出来效果怎么样?下图是猎者出海最近28天的GSC效果数据,可以直观感受一下一个做了一段时间的中文站,搜索流量大概是个什么量级:

28天总点击1586次,总曝光7.65万次,平均点击率2.1%,平均排名第9位。这就是搜索引擎工作原理那三步全跑通之后,每天稳定带来的免费流量。

谷歌、Bing、百度的排名逻辑差在哪

很多人以为做SEO就是做谷歌,其实Bing和百度也是流量来源,而且这三个搜索引擎的排名逻辑有一些关键差异,搞清楚了能少走弯路。

底层算法上,谷歌和Bing大致相同,百度也差不多。但核心差异在于对搜索意图的重视程度:谷歌最看重搜索意图,Bing也比较看重但稍弱一点,百度相对来说不太看重搜索意图,更看重网站权重。

百度有个特点,网站权重高就可以几乎为所欲为,权重高的网站即使页面不是产品页,也能拿到产品词的排名。这在谷歌那边是行不通的。

还有一个差异是语言。谷歌搜英文词,只会展示英文站,中文站基本拿不到英文词的排名;但Bing国内版和百度搜英文词时,反而是中文站排名优先。

所以如果你做的是中文站,谷歌、Bing、百度三个引擎可以同时做;如果做的是英文站,那基本就盯着谷歌,Bing顺带做。

有一点要说清楚:中文站和英文站在做SEO时,方法完全一样,没有任何区别。

差异只在于语言带来的搜索量和竞争度不同——英文词搜索量大、竞争激烈,中文词搜索量小、竞争弱、排名相对容易做。所以新手如果是中文用户,从中文站起步,拿结果会更快一些。

还有一个2026年特别强调的基础项是HTTPS,所有搜索引擎尤其谷歌和Bing都要求开启HTTPS加密协议,不开对关键词排名影响很大。GSC后台有专门的HTTPS状态监控:

非HTTPS网址数量必须保持是0,所有页面强制走HTTPS。猎者出海这个站432个页面全部是HTTPS,0个非HTTPS,这是基础项里最容易做但最不能漏的一项。

新手懂了原理,到底该怎么动手做SEO

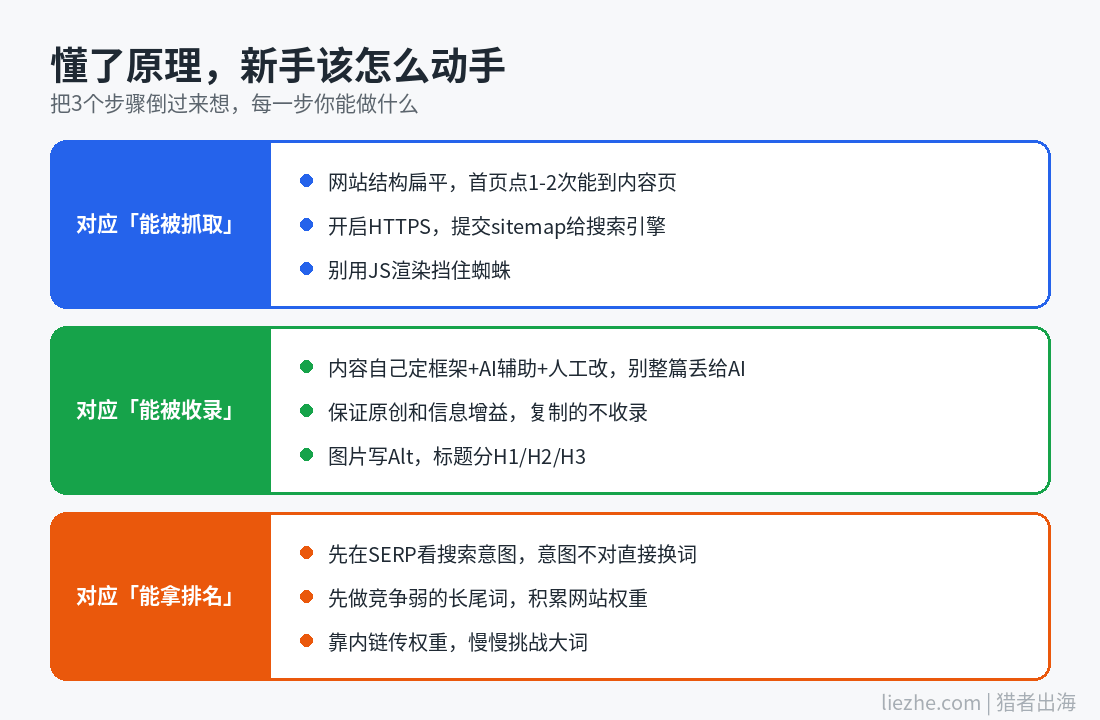

讲了这么多原理,落到实操,新手该怎么做?其实很简单,把刚才那三个步骤倒过来想,每一步你能做点什么,对应着做就行。

对应"能被抓取"这一步:

网站结构做扁平,首页点1到2次能到内容页;开启HTTPS;安装sitemap插件生成网站地图,提交给谷歌和Bing站长工具;别用纯JavaScript渲染挡住蜘蛛。这些都是技术层面的基础活,做一次就行。

对应"能被收录"这一步:

内容一定要保证原创和信息增益。猎者出海现在百分之七八十依赖AI辅助创作,但流程是自己定写作框架和角度,AI辅助写,最后人工修改,绝不是傻瓜式地丢一句"帮我写一篇文章"给AI。图片记得写Alt标签,标题分清楚H1、H2、H3层级。这一步做不好,前面抓取做得再好也是白费。

对应"能拿排名"这一步:

动笔之前先去搜索结果页看搜索意图,意图不对立刻换词;新手优先做竞争弱的长尾关键词,先拿到结果积累网站权重,再一级一级往上挑战大词;学会用内链传递权重,把权重传给那些最有提升空间的页面。

这里多说一句关于网站权重。

提升页面权重就三个核心点:用户搜索点击、内链传递、外链传递。

三者结合效果最好。市面上有些快排工具,原理就是模拟用户搜索点击你的网页,确实能快速上排名,但100%会被查到、100%会被降权,属于严重作弊。猎者出海绝对不碰这种东西,但它的存在恰恰说明,用户搜索点击对排名的影响是真的巨大。

最后提醒一点,SEO是个长期主义的项目。简单的关键词可能十几天到一个月排名就上去了,难度高的可能半年一年都上不去。不能短时间看不到效果就放弃。拿到关键词排名之后,基本是长期稳定的,一篇文章排到首页,可以一年多时间持续带来上万访客,这就是SEO最大的价值——流量免费、长期、稳定。

关于搜索引擎工作原理的常见问题

蜘蛛抓取了我的网页,为什么过了很久还没收录?

抓取不等于收录。最常见的原因是内容质量问题:跟互联网上已有内容重复度太高、是AI傻瓜式生成或改写的、信息增益为零。检查一下你的内容是不是真的提供了别处找不到的价值。如果你在GSC后台看到"已抓取-尚未编入索引"这一项数字很多,基本就是这个原因。

页面被收录了,为什么还是没有任何关键词排名?

大概率是搜索意图不匹配。比如你写了篇经验文章,但目标关键词的搜索结果页全是产品页,那谷歌就不会把你的文章排上去。去搜索结果页确认一下意图,意图不对就换词。

新手做SEO,应该先做谷歌还是百度?

看你的网站语言和目标用户。如果是面向中文用户的中文站,三个引擎可以一起做,但百度对新站前半年的收录率本来就不高。如果是英文站,盯着谷歌就行。猎者出海的流量里,谷歌排第一。

外链还重要吗?听说现在权重很低了?

外链权重确实从曾经的50%以上跌到了现在的13%左右,但13%依然不算低。只是相比以前,现在内容质量的权重更高了,新手与其花钱买外链,不如先把内容和站内SEO做扎实。

好了,搜索引擎工作原理这套底层逻辑就拆到这里。

说到底,谷歌对网页排名的整个过程,就是"能不能被抓取、值不值得被收录、配不配拿到排名"这三个问题层层筛选。把每一步对应的事情做到位,排名是水到渠成的结果。

想更系统地学SEO,或者有具体问题想问,欢迎关注猎者出海,也可以加倪叶明微信543890聊聊。

发表评论